Giải pháp Hạ tầng CNTT

Cơn Khát Điện Của AI Server: Hạ Tầng CNTT Đối Mặt Áp Lực Năng Lượng

Sự trỗi dậy của Trí tuệ nhân tạo (AI), đặc biệt là Generative AI (AI tạo sinh), đang định hình lại toàn bộ cảnh quan công nghệ toàn cầu. Để huấn luyện và vận hành các mô hình ngôn ngữ lớn (LLM), các trung tâm dữ liệu (Data Center) đang phải huy động một lượng lớn các hệ thống máy chủ AI (AI Server) với sức mạnh tính toán khổng lồ. Tuy nhiên, đằng sau những bước tiến đột phá về công nghệ là một bài toán nan giải: Cơn khát năng lượng. Các AI Server tiêu thụ lượng điện năng cao gấp nhiều lần so với máy chủ truyền thống, đặt hệ thống hạ tầng CNTT trước sức ép chưa từng có về cả nguồn cấp điện lẫn giải pháp tản nhiệt.

Bài viết dưới đây, NSTech sẽ đi sâu vào phân tích thực trạng “cơn khát điện” của máy chủ AI và những giải pháp chiến lược giúp doanh nghiệp tối ưu hóa hạ tầng CNTT trong kỷ nguyên mới.

Sự Bùng Nổ Của Kỷ Nguyên AI Và Sự Chuyển Dịch Sang AI Server

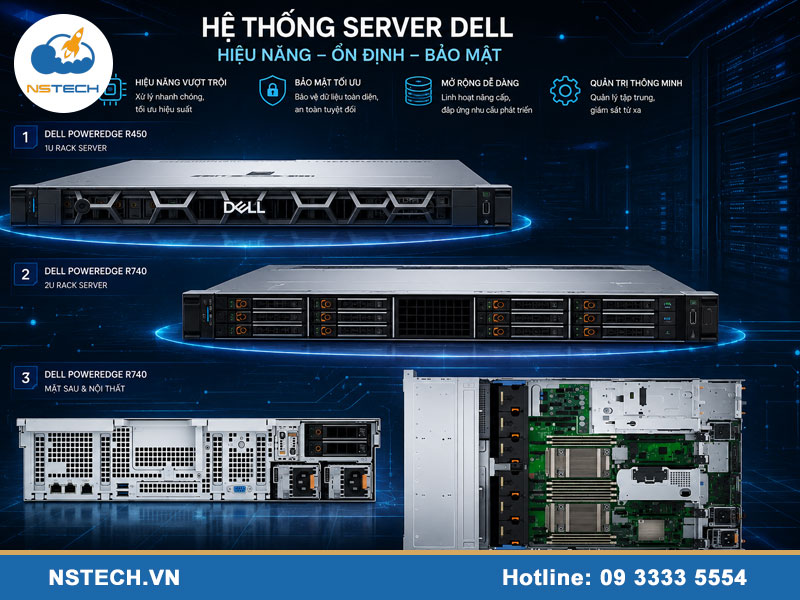

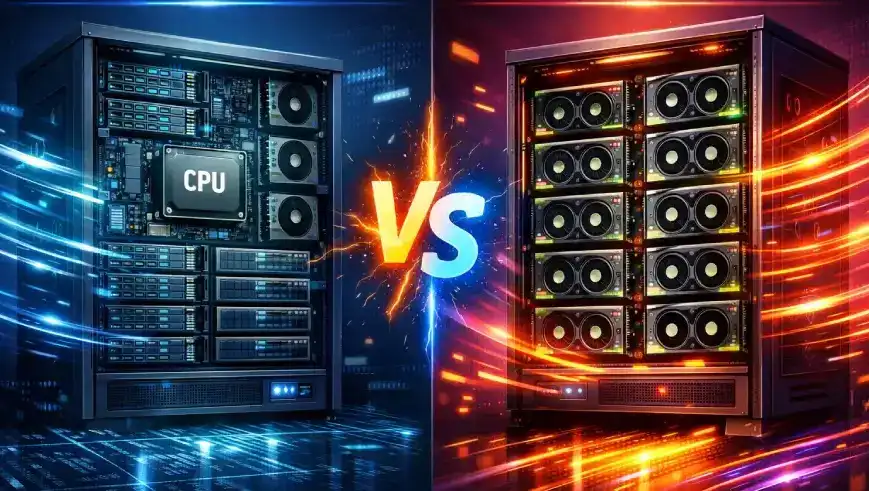

Trong hơn một thập kỷ qua, hạ tầng máy chủ chủ yếu dựa vào sức mạnh của các bộ vi xử lý trung tâm (CPU) để xử lý các tác vụ web, cơ sở dữ liệu và ứng dụng doanh nghiệp thông thường. Tuy nhiên, AI lại đòi hỏi một luồng kiến trúc hoàn toàn khác. Việc huấn luyện các mô hình AI yêu cầu khả năng xử lý song song hàng tỷ tham số cùng lúc, điều mà chỉ có các Bộ xử lý đồ họa (GPU) hoặc các vi mạch chuyên dụng (ASIC, TPU) mới có thể đảm đương hiệu quả.

Sự chuyển dịch này dẫn đến sự ra đời của các AI Server – những cỗ máy tính toán khổng lồ được trang bị từ 4, 8 đến 16 GPU hiệu năng cao trên một bo mạch duy nhất.

Gợi ý: Xu Hướng AI Server Và Data Center Giai Đoạn 2025–2030

Sự gia tăng đột biến về mật độ linh kiện hiệu năng cao trên cùng một không gian vật lý (Form Factor) đã biến các máy chủ AI trở thành những “con quái vật” tiêu thụ điện năng. Việc nâng cấp từ hạ tầng máy chủ cũ sang các hệ thống máy chủ AI không chỉ đơn thuần là việc mua sắm thiết bị mới, mà là một cuộc đại tu toàn diện về cách chúng ta thiết kế và vận hành trung tâm dữ liệu.

Cơn Khát Năng Lượng: Những Con Số Thực Tế Về Tiêu Thụ Điện Của Máy Chủ AI

Để hiểu rõ mức độ nghiêm trọng của áp lực năng lượng, chúng ta cần nhìn vào những con số thực tế.

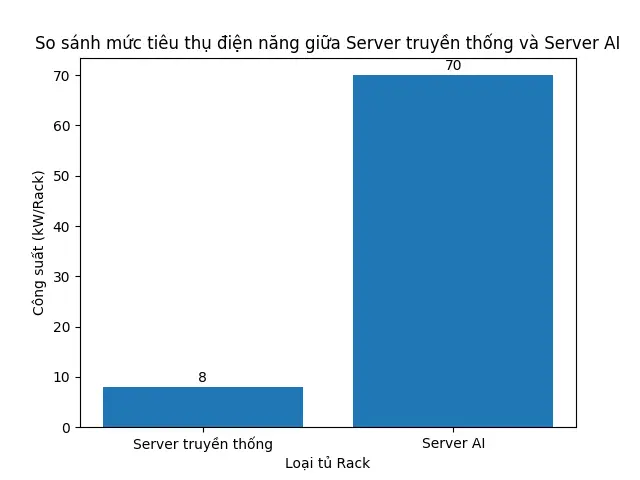

Một máy chủ doanh nghiệp (Enterprise Server) tiêu chuẩn chạy các ứng dụng văn phòng hoặc cơ sở dữ liệu thường có công suất tiêu thụ điện (TDP) dao động từ 500W đến 1000W. Một tủ mạng (Rack) tiêu chuẩn trong Data Center thường được thiết kế để chịu tải khoảng 5kW đến 10kW.

Tuy nhiên, với AI Server, câu chuyện hoàn toàn khác biệt:

- Tiêu thụ điện của từng linh kiện: Một chiếc GPU chuyên dụng cho AI có thể tiêu thụ từ 350W đến hơn 700W điện năng (ví dụ: dòng NVIDIA H100 tiêu thụ tối đa lên tới 700W). Khi một máy chủ AI được lắp 8 chiếc GPU như vậy, cùng với CPU kép hiệu năng cao, lượng RAM khổng lồ và hệ thống lưu trữ tốc độ cao, tổng công suất của một máy chủ duy nhất có thể dễ dàng vượt mốc 6.000W (6kW) đến 10.000W (10kW).

- Mật độ điện năng trên mỗi Tủ Rack: Khi xếp chồng nhiều máy chủ AI vào cùng một tủ rack, mật độ điện năng có thể vọt lên mức 40kW, 60kW, thậm chí hơn 100kW/Rack.

Xem thêm: Cuộc đua AI Server nóng lên với sự xuất hiện của Dell PowerEdge Gen 17

Sự chênh lệch khủng khiếp này tạo ra một “nút thắt cổ chai” về năng lượng. Khắp nơi trên thế giới, nhiều Data Center đang gặp tình trạng có sẵn không gian trống (diện tích sàn) nhưng lại không thể lắp đặt thêm máy chủ AI vì hệ thống lưới điện và trạm biến áp không đủ công suất để cấp nguồn.

Áp Lực Khổng Lồ Lên Hạ Tầng Data Center: Tản Nhiệt Và Môi Trường

Đi kèm với việc tiêu thụ lượng điện năng khổng lồ là việc tỏa ra một lượng nhiệt tương đương. Định luật bảo toàn năng lượng chỉ ra rằng gần như toàn bộ điện năng đi vào máy chủ cuối cùng sẽ chuyển hóa thành nhiệt năng. Đây chính là thách thức lớn thứ hai đối với hạ tầng CNTT: Tản nhiệt (Cooling).

Giới Hạn Của Hệ Thống Làm Mát Bằng Không Khí (Air Cooling)

Suốt nhiều thập kỷ, các trung tâm dữ liệu sử dụng hệ thống điều hòa không khí chính xác (CRAC/CRAH) kết hợp với thiết kế sàn nâng và hành lang nóng/lạnh để làm mát máy chủ. Tuy nhiên, phương pháp tản nhiệt bằng không khí truyền thống đang chạm đến giới hạn vật lý.

Khi mật độ nhiệt vượt quá 20-30kW/Rack, không khí không còn đủ khả năng hấp thụ và mang nhiệt đi đủ nhanh. Quạt tản nhiệt bên trong máy chủ AI phải hoạt động ở tốc độ tối đa, tạo ra tiếng ồn khủng khiếp và chính bản thân các quạt này cũng tiêu thụ thêm một lượng điện năng không nhỏ (chiếm tới 10-15% tổng điện năng của máy chủ).

Bài Toán Chỉ Số PUE Và Áp Lực Môi Trường (ESG)

Chỉ số Hiệu quả Sử dụng Năng lượng (PUE – Power Usage Effectiveness) là thước đo quan trọng của Data Center. PUE càng gần 1.0 càng tốt. Với lượng nhiệt khổng lồ từ AI Server, các hệ thống làm mát truyền thống phải chạy “hết công suất”, làm tăng vọt chỉ số PUE. Điều này không chỉ đẩy chi phí vận hành (OPEX) lên mức chóng mặt mà còn đi ngược lại các mục tiêu phát triển bền vững (ESG) và giảm phát thải Carbon mà các tập đoàn công nghệ toàn cầu đang hướng tới.

Giải Pháp Tối Ưu Năng Lượng Và Hạ Tầng CNTT Cho Làn Sóng AI

Đứng trước cơn khát năng lượng và nhiệt lượng của máy chủ AI, các nhà quản trị hạ tầng CNTT và quản lý Data Center buộc phải tìm kiếm các giải pháp công nghệ mới mang tính đột phá. Dưới đây là những hướng đi đang được áp dụng rộng rãi:

Chuyển Dịch Sang Tản Nhiệt Bằng Chất Lỏng (Liquid Cooling)

Tản nhiệt bằng không khí đã chạm “trần” giới hạn với các dòng GPU công suất cao (700W – 1000W). Để giải quyết tình trạng quá nhiệt, hạ tầng cần nâng cấp lên:

- Direct-to-Chip (D2C): Dẫn chất lỏng làm mát trực tiếp đến CPU và GPU, triệt tiêu 70-80% nhiệt lượng tại nguồn.

- Tản Nhiệt Nhúng (Immersion Cooling): Nhúng toàn bộ linh kiện vào dung dịch điện môi, loại bỏ 100% quạt tản nhiệt cơ học, đưa chỉ số PUE về mức tối ưu (gần 1.0).

Tìm hiểu: Công nghệ Liquid Cooling – Giải pháp tản nhiệt thế hệ tiếp theo cho Data Center

Nâng Cấp Hệ Thống Nguồn (PSU) Và Hạ Tầng Điện

Mật độ điện năng khổng lồ yêu cầu hệ thống cấp điện phải ổn định tuyệt đối:

- Bộ Nguồn (PSU) Chuẩn Titanium: Đạt hiệu suất chuyển đổi >96%, giảm thiểu điện năng hao phí.

- Thanh Nguồn Thông Minh (Intelligent PDU): Giám sát điện năng tiêu thụ theo thời gian thực đến từng ổ cắm để tránh quá tải.

- Hệ Thống Lưu Điện (UPS) Lithium-ion: Cung cấp mật độ năng lượng cao, xả tải nhanh chóng để đáp ứng các “cú sốc” điện năng khi GPU chạy tối đa công suất.

Tối Ưu Bằng Phần Mềm Quản Trị DCIM Tích Hợp AI

Phần cứng là nền tảng, phần mềm là chìa khóa. Các hệ thống Quản trị Hạ tầng Trung tâm Dữ liệu (DCIM) hiện đại sử dụng AI để tự động điều phối luồng khí/chất lỏng làm mát đến chính xác các tủ Rack đang tải nặng. Đồng thời, hệ thống sẽ tự động đưa các máy chủ nhàn rỗi vào chế độ ngủ sâu, cắt giảm triệt để chi phí OPEX.

Bảo Mật Hiệu Suất Cao Không Gây “Nút Thắt Cổ Chai”

Hệ thống AI xử lý khối lượng dữ liệu khổng lồ. Nếu dùng phần mềm bảo mật thông thường, tài nguyên CPU/GPU sẽ bị tiêu hao lãng phí. Giải pháp là sử dụng Tường lửa thế hệ mới (NGFW) xử lý bằng phần cứng chuyên dụng. Việc tích hợp các giải pháp bảo mật từ các hãng lớn như Palo Alto Networks giúp bảo vệ luồng dữ liệu AI an toàn tuyệt đối bằng Machine Learning mà không làm suy giảm hiệu năng tổng thể của Data Center.

Lựa Chọn Đối Tác Tích Hợp Hạ Tầng Có Bề Dày Kinh Nghiệm

Chuyển đổi hạ tầng AI là một bài toán quy hoạch tổng thể. Doanh nghiệp cần hợp tác với các nhà tích hợp hệ thống uy tín, đặc biệt là các đơn vị có vị thế Master Dealer và bề dày kinh nghiệm gần 2 thập kỷ trong ngành. Một đối tác chuyên nghiệp sẽ tư vấn lộ trình nâng cấp chuẩn xác từ các máy trạm Workstation cho khâu R&D ban đầu, đến các cụm AI Server hoàn chỉnh, đảm bảo tối ưu hóa cả chi phí đầu tư (CAPEX) và vận hành (OPEX).

Lời Khuyên Cho Doanh Nghiệp: Chuẩn Bị Gì Để Đón Đầu Kỷ Nguyên Máy Chủ AI?

Việc đầu tư vào AI Server là một bước đi tất yếu để duy trì lợi thế cạnh tranh, nhưng nếu không chuẩn bị kỹ lưỡng về hạ tầng, doanh nghiệp sẽ phải đối mặt với rủi ro quá tải điện năng, gián đoạn hệ thống và lãng phí ngân sách. Để sẵn sàng, các doanh nghiệp cần lưu ý:

Đánh giá lại toàn diện hạ tầng hiện tại: Trước khi đưa máy chủ AI vào vận hành, cần có chuyên gia đánh giá công suất tối đa của hệ thống điện, khả năng chịu tải của UPS, và giới hạn của hệ thống làm mát tại phòng máy chủ hiện hữu.

Xem thêm: máy chủ Dell Gen 17 đón đầu xu thế AI toàn cầu

Đầu tư đồng bộ và tính toán tổng chi phí sở hữu (TCO): Không chỉ tính chi phí mua phần cứng (CAPEX), doanh nghiệp phải đặc biệt lưu tâm đến chi phí tiền điện và bảo trì (OPEX). Một máy chủ có hiệu suất năng lượng tốt ban đầu có thể đắt hơn, nhưng sẽ tiết kiệm hàng ngàn đô la tiền điện mỗi năm.

Quy hoạch lại không gian máy chủ: Không phân bổ dàn trải. Đối với các cụm AI, nên thiết kế các khu vực (zone) làm mát năng lực cao riêng biệt trong Data Center thay vì đặt chung với các máy chủ truyền thống.

Tối Ưu Hạ Tầng Năng Lượng Cùng NSTech Việt Nam: Bứt Phá Trong Kỷ Nguyên AI

Cơn khát năng lượng của AI Server không phải là rào cản, mà là chất xúc tác buộc các Data Center phải tiến hóa. Việc nâng cấp toàn diện từ công nghệ tản nhiệt, hệ thống nguồn cấp, phần mềm quản trị DCIM cho đến kiến trúc bảo mật là lộ trình bắt buộc để doanh nghiệp tối ưu hóa tổng chi phí sở hữu (TCO) và không bị bỏ lại phía sau. Hạ tầng CNTT vững chắc, tối ưu năng lượng giờ đây chính là bệ phóng quyết định tốc độ bứt phá của doanh nghiệp trong kỷ nguyên Trí tuệ nhân tạo.

Đừng để giới hạn của hạ tầng cũ làm chậm nhịp độ đổi mới của doanh nghiệp bạn. Đánh dấu chặng đường 18 năm đồng hành và phát triển cùng công nghệ, NSTech sẵn sàng cùng bạn giải bài toán nâng cấp toàn diện này.

Từ việc cung cấp các cụm máy chủ AI công suất lớn, hệ thống Workstation mạnh mẽ cho khâu R&D, linh kiện máy chủ chuyên dụng, cho đến thiết kế giải pháp hạ tầng đồng bộ. Đặc biệt, với vị thế là Master Dealer của Palo Alto Networks, chúng tôi cam kết kiến tạo một hệ sinh thái AI không chỉ mạnh mẽ về hiệu năng mà còn an toàn tuyệt đối về dữ liệu.

Hãy liên hệ ngay với đội ngũ chuyên gia của chúng tôi để được tư vấn khảo sát và thiết kế lộ trình nâng cấp Data Center tối ưu nhất!

Website: https://nstech.vn/

Hotline: 09 3333 5554

Email: ducnh@nstech.vn

Tôi là Hoàng Đức – CEO Công ty Cổ phần NSTECH Việt Nam. Với nhiều năm kinh nghiệm trong lĩnh vực hạ tầng máy chủ và giải pháp công nghệ, tôi định hướng NSTECH không chỉ là đơn vị cung cấp thiết bị, mà là đối tác chiến lược giúp doanh nghiệp xây dựng nền tảng IT ổn định, an toàn và bền vững.